À la demande d’Etalab, 8 élèves de l’ENA (promotion Molière) ont travaillé pendant 4 mois sur un rapport destiné à formuler des propositions concrètes pour favoriser un usage transparent et éthique des algorithmes publics par les administrations. Ils témoignent ici de leur expérience à l’occasion de la publication de ce rapport.

Élèves de l’École nationale d’administration (ENA), nous avons réalisé dans le cadre de notre scolarité et à la demande d’Etalab un rapport intitulé « Éthique et responsabilité des algorithmes publics ». Derrière cette expression se cachent plusieurs enjeux de taille. Premièrement, garantir la mise en œuvre du cadre juridique issu de la loi pour une République numérique destiné à assurer un usage transparent des algorithmes par les administrations publiques. Deuxièmement, favoriser un usage responsable, non-discriminant et maîtrisé des algorithmes par les agents publics alors même que l’image de la « boîte noire » à laquelle ces outils sont souvent renvoyés risque de distendre un peu plus les liens entre les citoyens et l’administration.

Qui sommes-nous ?

Élèves de l’ENA en scolarité à Strasbourg, nous sommes pour partie des élèves-fonctionnaires français et pour partie des élèves internationaux, agents publics dans leurs pays, venus se perfectionner à l’ENA. Plus ou moins familiers des algorithmes par nos parcours antérieurs, nous nous sommes penchés avec enthousiasme sur ce sujet pendant 4 mois.

Quels étaient nos objectifs ?

L’usage des algorithmes publics a récemment fait l’objet d’un encadrement juridique. La loi dite pour une République numérique (2016) a ainsi prévu un certain nombre d’obligations pour les administrations lorsqu’elles recourent à des algorithmes pour fonder des décisions administratives individuelles. Par exemple, les administrations utilisant des algorithmes pour calculer le montant d’une prestation sociale ou décider de l’attribution d’un service public comme l’obtention d’une place en crèche, doivent publier en ligne les principales règles à laquelle sont soumis ces algorithmes et notifier à l’intéressé que cette décision a été prise sur le fondement d’un algorithme (une « mention explicite » doit alors figurer sur la décision administrative). Elles doivent également être en mesure de préciser – à la demande de l’intéressé – la manière dont l’algorithme a abouti à la décision en question. Ces différentes obligations se retrouvent aujourd’hui dans le code des relations entre le public et l’administration (CRPA).

Afin de faciliter la mise en œuvre par les administrations de ces obligations, nous avons été chargés de mesurer les difficultés qu’elles pouvaient rencontrer et de proposer des outils concrets, destinés à venir enrichir le guide des algorithmes publics publié par Etalab.

Par ailleurs, si les obligations issues de la loi pour une République numérique doivent permettre d’assurer la transparence des algorithmes et de leur usage par l’administration, le travail d’explicitation qui en découle n’épuise en rien les questions éthiques soulevées par les algorithmes. S’assurer que le recours à un algorithme n’exonère en rien l’administration de ses responsabilités, garantir un usage non-discriminant de ces outils, s’assurer que l’algorithme traduit fidèlement le cadre juridique qu’il est censé appliquer : voici quelques uns des enjeux auxquels nous avons souhaité réfléchir, en cherchant, ici encore, à fournir aux administrations des outils clés en main afin de favoriser le bon développement et l’usage responsable des algorithmes publics.

Comment avons-nous travaillé ?

Impossible de mesurer le degré d’appropriation des enjeux juridiques et éthiques des algorithmes publics sans échanger avec celles et ceux qui les élaborent et les utilisent au quotidien ! Nous sommes donc allés rencontrer des agents travaillant dans des services informatiques, juridique et métiers, au sein de l’État et de ses opérateurs mais également dans les collectivités locales, en variant au maximum les niveaux hiérarchiques. Au total, ce sont près d’une cinquantaine d’agents publics qui ont accepté de partager leur expérience des algorithmes avec nous.

En multipliant les points de vue et les expertises, nous avons peu à peu identifié certaines difficultés de compréhension du cadre juridique en vigueur. Ces différents entretiens nous ont également permis de découvrir que si certains acteurs étaient parfaitement au fait des obligations juridiques et des questions que soulèvent les algorithmes. Le degré de connaissance variait néanmoins selon les administrations et était souvent très inégal au sein d’un même structure. Ainsi, en l’absence d’une définition partagée par l’ensemble des agents publics de ce que sont les algorithmes, certains de nos interlocuteurs – tels M. Jourdain faisant de la prose sans le savoir – ne pensaient pas en utiliser au quotidien dans leur travail, le terme « algorithme » renvoyant essentiellement pour eux à des outils mobilisant des techniques d’intelligence artificielle. À travers ces différents entretiens, c’est ainsi un premier travail de sensibilisation que nous avons parfois mené.

Surtout, les outils que nous avons élaborés, l’ont été en lien avec des acteurs clés des algorithmes publics. Administrateurs ministériels des données (AMD), chief data officer, délégués à la protection de données personnes (DPD), personne responsable de l’accès aux documents administratifs (PRADA) : nous avons eu la chance de pouvoir tester auprès de certains d’entre eux nos propositions afin de nous assurer de leur pertinence.

Concrètement, que proposons-nous ?

Afin d’assurer la mise en œuvre du cadre juridique issu de la loi pour une République numérique, nous proposons de mettre à la disposition des administrations un certain nombre d’outils. Alors que ces dernières nous ont parfois fait part de leurs réticences à mettre en œuvre ces obligations, du fait de leur supposée lourdeur et de leur difficulté à percevoir précisément les exigences posées par le CRPA, notre rapport propose des pistes pour expliciter les différents critères prévus par les textes et identifie des exemples de mise en œuvre satisfaisante de chacune des obligations prévues, à diffuser auprès des administrations. De la même manière, nous proposons de favoriser la diffusion d’un modèle type de mention explicite, afin de faciliter le travail aux administrations devant y avoir recours.

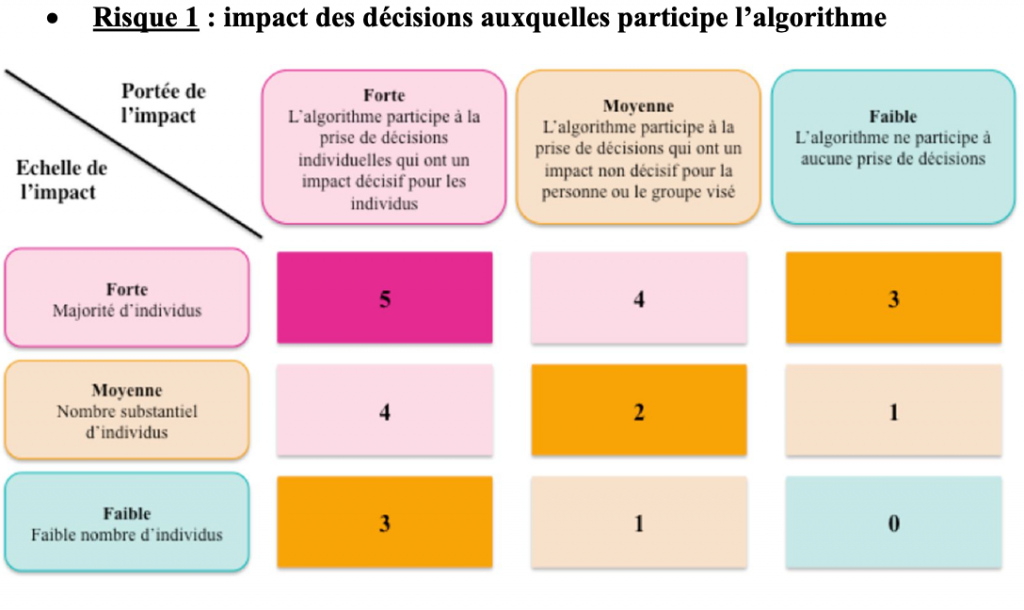

Concernant les enjeux éthiques, nul besoin de prévoir de nouvelles obligations législatives ou réglementaires : l’enjeu est avant tout organisationnel. Identifier au mieux les responsabilités avant tout déploiement, faire travailler ensemble les services juridiques, informatiques et métiers (ainsi que les prestataires lorsque l’algorithme est développé en externe), former l’ensemble des acteurs de la chaîne algorithmes apparaissent en effet comme autant de bonnes pratiques à favoriser. Par ailleurs, afin d’accompagner au mieux les administrations, nous proposons de mettre à leur disposition une « échelle de risques » et un « parcours de questionnement » : ces deux outils doivent leur permettre de mieux appréhender la sensibilité des traitements algorithmiques qu’ils utilisent mais aussi d’identifier les questions auxquelles les différents services se devront de répondre, tant lors de son élaboration que de son utilisation.

Et maintenant ?

Après avoir remis notre rapport à Etalab, nous avons eu l’occasion de présenter notre travail devant les agents de la DINUM, puis à l’occasion de la Semaine de l’Innovation Publique fin 2019. Ce travail de sensibilisation que nous avons entrepris doit encore être poursuivi, les enjeux éthiques des algorithmes étant aujourd’hui un sujet incontournable des réflexions autour de l’innovation publique.

Manon Chonavel, Sylvia Saint-Cierge, Thibault de Cacqueray, Nathan Haik, Mélanie Marquer, Erwann Dumont – élèves de l’ENA promotion Molière.