Ce blogpost conclut une série rétrospective de l’année 2020 autour d’axes de travail d’Etalab: ouvrir les codes sources, ouvrir et faire circuler les données publiques, accompagner les administrations à travers le programme EIG, organiser la production des données, accompagner les administrations sur la transparence des algorithmes.

La fin de l’année 2019 avait été marquée par la remise du rapport des élèves de la promotion Molière de l’ENA sur l’éthique et la responsabilité des algorithmes publics. Ce travail a permis de prendre la mesure des enjeux et de leur compréhension par les administrations. Il appelait aussi à des efforts renouvelés pour expliquer, illustrer et accompagner les démarches des ministères et des collectivités en faveur d’un usage responsable des algorithmes publics. Cette recommandation a largement guidé les actions menées par Etalab sur le sujet en 2020.

Une communauté autour des algorithmes publics

Tout au long de l’année, Etalab a mobilisé une communauté forte de près de 150 membres aux profils variés: agents des ministères et des collectivités, membres de la communauté scientifique, membres de la société civile, acteurs associatifs et économiques. Crise sanitaire oblige, la plupart de ces mobilisations ont eu lieu en ligne, dans des formats divers (webinaires, ateliers de co-production, simulations, enquête quantitative, etc.).

Ce travail a permis d’enrichir les ressources mises à disposition en ligne, en particulier le guide des algorithmes publics dont une première version a été publiée en 2018. La nouvelle version prend en compte les retours qui nous ont été formulés. Parmi les nouveautés: l’articulation entre les obligations du CRPA et celles issues du RGPD, mais aussi et surtout une fiche pratique sur l’obligation de mention explicite. Une seconde fiche pratique, sur l’inventaire des principaux traitements algorithmiques, est venue compléter ce kit de ressources au début de l’année 2021.

Des ateliers pour co-construire des ressources et partager des bonnes pratiques

Se mettre dans la peau des individus impactés par les systèmes algorithmiques

En mars 2020, quelques jours avant le premier confinement, nous avons réuni dans nos locaux à Paris une vingtaine de participants, de profils variés (agents des administrations, chercheurs, représentants de la société civile). Leur mission: critiquer et améliorer la première version du guide des algorithmes publics. La méthode: une immersion dans trois cas d’usage, inspirés de la réalité.

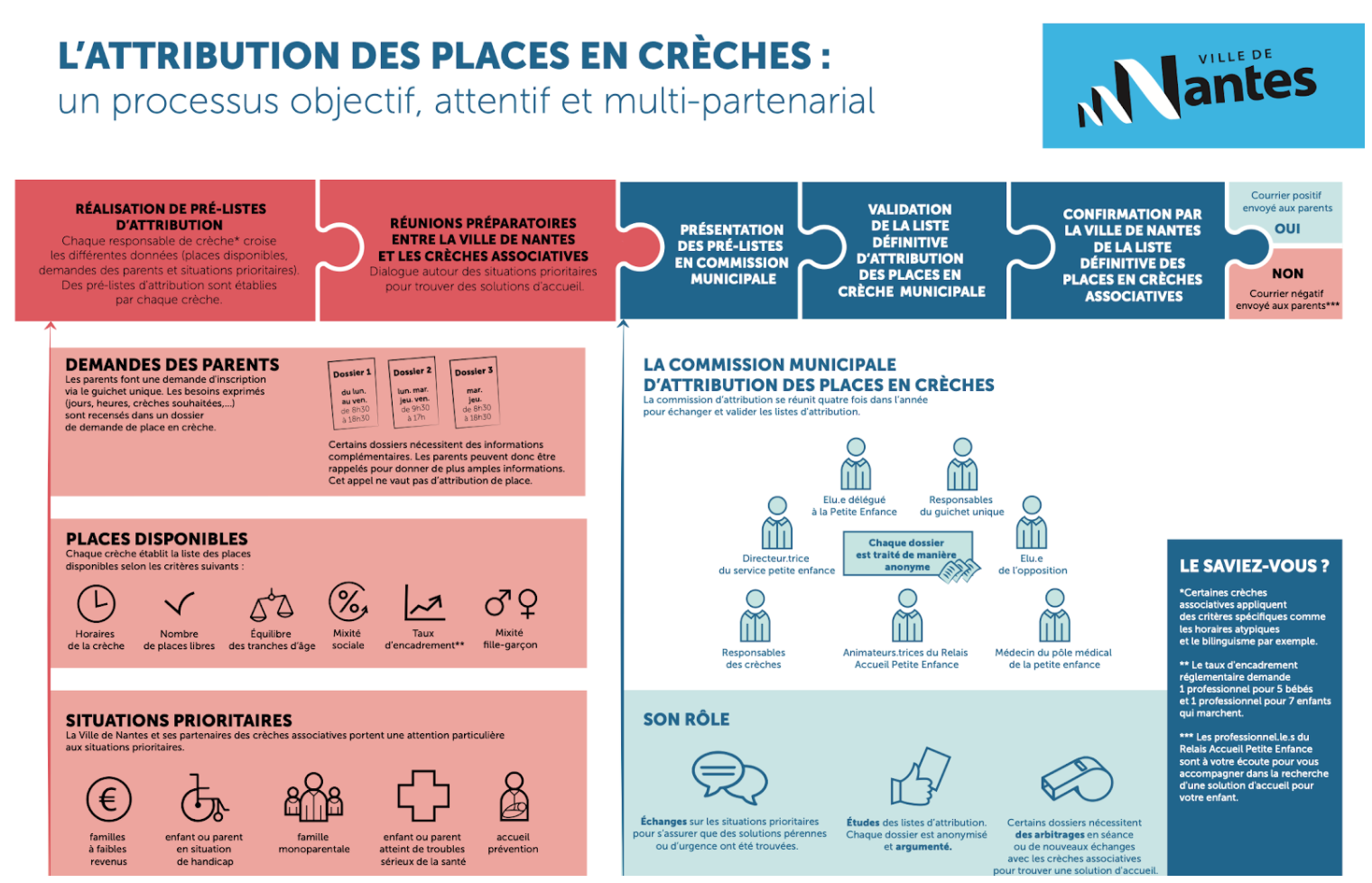

Ainsi, ils ont pu se mettre dans la peau d’un parent qui sollicite une place en crèche municipale, d’un enseignant du second degré qui demande une mutation dans une nouvelle académie ou encore dans celle du voyageur qui utilise le système de reconnaissance faciale lui permettant de franchir plus rapidement les contrôles d’identité à l’aéroport de Paris Charles de Gaulle (le système Parafe). Cet atelier a notamment permis d’identifier plusieurs axes d’amélioration du guide des algorithmes publics, que nous avons ensuite mis en œuvre au cours de l’année.

L’attribution de places en crèche, un exemple d’utilisation d’algorithmes dans le secteur public.

Construire des explications pour les utilisateurs de systèmes d’Intelligence artificielle

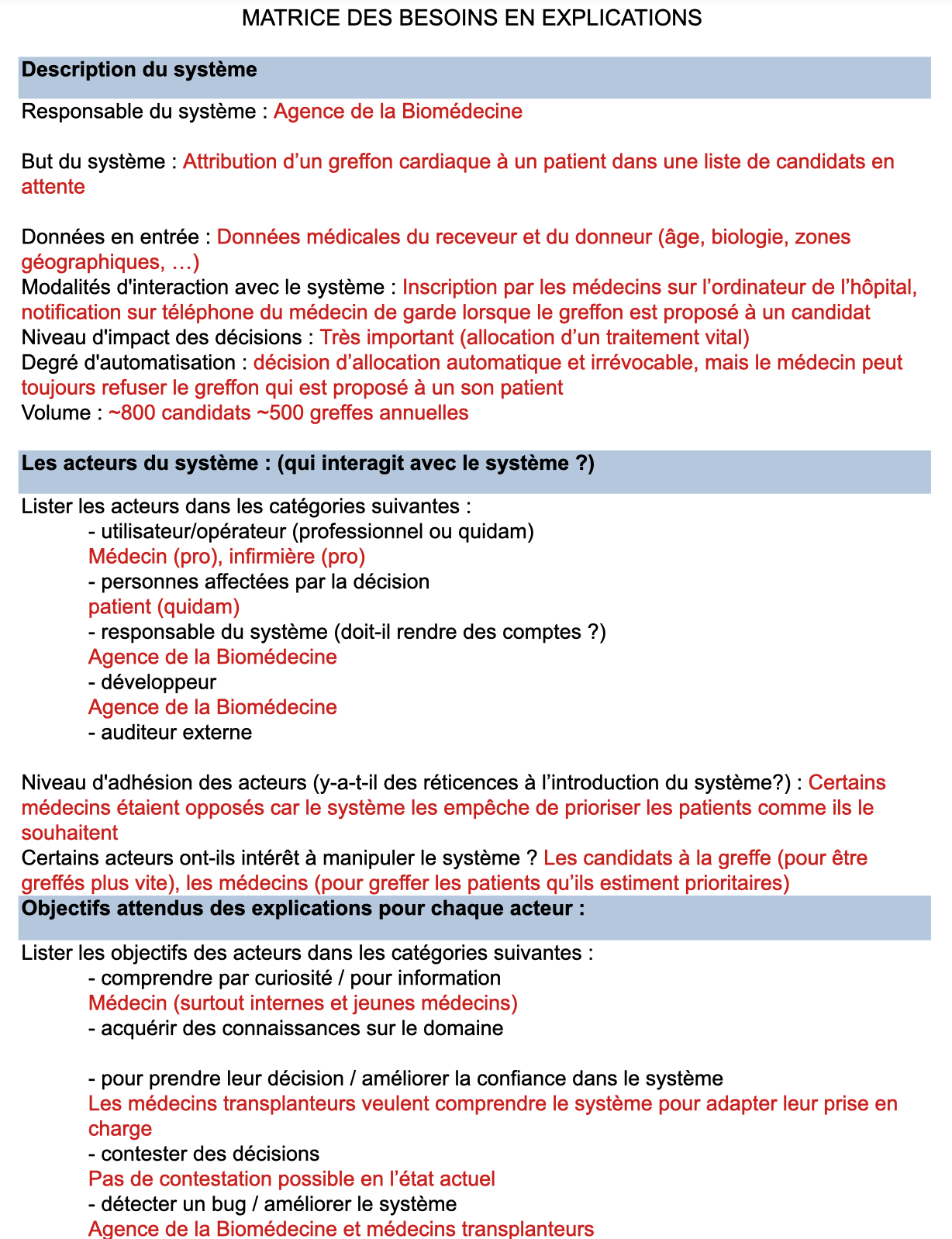

En juillet 2020, à l’invitation de l’équipe du LabIA d’Etalab nous avons coanimé un atelier avec Clément Henin de l’INRIA. Une quinzaine de projets lauréats de l’appel à manifestation d’intérêt IA ont identifié les besoins en explication de leur système.

En effet, au-delà de la transparence, la capacité d’un système à être explicable figure parmi les éléments clés d’un usage responsable des algorithmes publics. A l’aide d’un outil “matrice des besoins en explication”, chaque administration a pu identifier le type et le niveau de détail d’explication à fournir pour chacun des acteurs du système.

Prenons le cas du projet d’un Centre hospitalier universitaire qui développe un moteur de recherche intelligent dans les dossiers patients. Les “cibles” de l’explication peuvent être non seulement le médecin qui va utiliser ce système (qui est en droit de demander pourquoi tel résultat est mis en avant par le système), mais aussi le commanditaire (qui aura besoin de comprendre la mécanique générale et s’assurer de la maîtrise des risques éventuels, par exemple en matière de biais) voire les représentants des patients, par exemple si les décisions prises ont un impact sur la prise en charge médicale. De même, chaque explication peut répondre à des objectifs différents: comprendre pour faire confiance, comprendre par curiosité, acquérir des informations sur un domaine, prendre ou contester des décisions prises à l’aide d’un système automatisé, etc.

Expliquer un algorithme: pourquoi ? pour qui ? comment ?

Préparer un modèle d’inventaire des algorithmes publics

Mi-2020, Etalab a sollicité un petit nombre d’administrations pour participer à un groupe de travail informel, en ciblant en priorité celles qui avaient manifesté leur intérêt pour le sujet des algorithmes. Nous avons fait le pari d’animer un groupe mêlant des ministères et des collectivités locales dans une même démarche. Ainsi, d’octobre à décembre 2020, nous avons animé cinq sessions de travail. Autour de la table (ou plutôt, de l’écran) : Maryse Le Bras, du Ministère de l’Education nationale, Cécile Le Guen, de la Direction des douanes et des droits indirects, Anthony Claverie de la Ville d’Antibes et Nathalie Vernus Prost de la Métropole de Lyon.

Le point de départ de nos travaux était l’article du Code des relations entre le public et l’administration qui évoque l’inventaire des algorithmes publics. Voilà ce qui dit le texte: les administrations sont tenues de publier en ligne “les règles définissant les principaux traitements algorithmiques utilisés dans l’accomplissement de leurs missions lorsqu’ils fondent des décisions individuelles”.

Le point d’arrivée est un modèle d’inventaire des algorithmes publics en version beta. Ce modèle, une fois consolidé, pourra être adopté par toute administration souhaitant publier son propre inventaire et se mettre ainsi en conformité avec la loi. La ville d’Antibes a d’ores et déjà publié une première version de son inventaire à l’aide de ce modèle.

Des webinaires pour répondre aux questions des administrations

En juin 2020, nous avons organisé en collaboration avec les juristes d’Etalab, Perica Sucevic et Cindy Kus un premier webinaire dédié aux algorithmes publics. Une centaine de participants sont venus échanger et poser leurs questions. A cette occasion, nous avons aussi publié un modèle de mention explicite. L’occasion de rappeler que, pour les décisions entièrement automatisées, une telle mention est obligatoire depuis juillet 2020, sous peine de nullité.

Un webinaire pour présenter les obligations de transparence des algorithmes

Un deuxième webinaire, consacré à l’inventaire des algorithmes, a été proposé en février 2021, avec le témoignage des membres du groupe de travail sus-mentionné. Ce format, qui mêle interactivité et mise à disposition de ressources opérationnelles, a recueilli de nombreux avis positifs.

Participer à la discussion en France et dans le Monde

En 2020, l’équipe algorithmes publics a participé à la discussion au niveau mondial. Le Partenariat pour un gouvernement ouvert (OGP) a lancé un groupe « Open Algorithms » avec quelques pays pionniers dans ce domaine. C’est l’occasion de présenter les travaux engagés en France et d’échanger avec nos homologues du Canada, du Royaume-Uni, des Pays-Bas et de la Nouvelle-Zélande. De même, nous sommes intervenus dans plusieurs conférences et rencontres internationales: FAT* 2020 (session commune avec l’ONG AlgorithmWatch), RightsCon 2020, un séminaire organisé par l’OSCE, une table-ronde organisée par l’Ada Lovelace Institute au Royaume-Uni. L’agenda des rencontres en France a aussi été bien fourni avec la participation aux rencontres Numérique en Commun(s), au Salon de la Data et à un évènement organisée par Stéréolux.

Les collaborations avec la recherche universitaire ont été multiples, avec notamment l’accueil de Fiona du Mesnildot (Cité du Design Saint Etienne) pendant quelques mois chez Etalab, mais aussi des sessions de travail avec le Medialab de SciencesPo ou encore la participation à un séminaire organisé par l’Université de Nice (dans le cadre du Master Droit algorithmique dirigé par Caroline Lequesne Roth).

En route pour 2021

En 2021, nous souhaitons tout d’abord « boucler » notre trilogie sur les obligations de transparence des algorithmiques telles qu’elles figurent dans le Code des relations entre le public et l’administration. Après la mention explicite, puis l’inventaire, nous allons publier des ressources permettant de répondre aux demandes d’explication individuelle. Un webinaire sera organisé d’ici l’été pour présenter ces ressources et échanger avec la communauté mobilisée depuis 2 ans maintenant.

En fin d’année 2020, plusieurs collaborations ont été initiées, notamment avec l’équipe de Design Frictions (sur l’imaginaire des algorithmes) et Elisabeth Lehagre de Babotics (sur les outils d’évaluation d’impact algorithmique). Ces travaux donneront lieu à des publications et à des évènements ouverts à tous cette année.

Par ailleurs, nous souhaitons poursuivre en 2021 les échanges au niveau international, notamment via le groupe Open Algorithms de l’OGP.

Pour nous contacter: algorithmes@etalab.gouv.fr